-

Borsa: Asia giù con Tokyo a -3,38%, l'Europa e attesa in rosso

Borsa: Asia giù con Tokyo a -3,38%, l'Europa e attesa in rosso

-

Prezzo petrolio in aumento, Wti scambiato a 97,21 dollari + rpt+

-

Euro poco mosso, scambiato a 1,1462 dollari

Euro poco mosso, scambiato a 1,1462 dollari

-

Lamborghini, 3,2 miliardi di fatturato nel 2025, 768 milioni il risultato operativo

-

Prezzo oro in calo, Spot scambiato a 4.793 dollari

Prezzo oro in calo, Spot scambiato a 4.793 dollari

-

Prezzo oro in aumento, Wti scambiato a 97,21 dollari

-

Shenzhen celebra l'Italian design day

Shenzhen celebra l'Italian design day

-

Borsa: Hong Kong in calo nelle prime battute, Hang Seng -1,51%

-

Media: 'Trump valuta l'invio di migliaia di soldati in Medio Oriente'

Media: 'Trump valuta l'invio di migliaia di soldati in Medio Oriente'

-

Borsa: Tokyo, apertura in netto ribasso (-1,68%)

-

Cuba, convoglio umanitario dall'Italia arriva all'Avana con aiuti europei

Cuba, convoglio umanitario dall'Italia arriva all'Avana con aiuti europei

-

Tennis: Musetti non giocherà il Masters di Miami

-

Incontro tra Meloni e Merz a Bruxelles

Incontro tra Meloni e Merz a Bruxelles

-

Bomba in Colombia, Quito e Bogotà formano commissione congiunta di indagine

-

'Quattro donne palestinesi uccise e 6 ferite da bomba a grappolo a Hebron'

'Quattro donne palestinesi uccise e 6 ferite da bomba a grappolo a Hebron'

-

Champions: Liverpool ai quarti, Galatasaray ko 4-0

-

Champions: 2-3 col Tottenham, Atletico Madrid ai quarti

Champions: 2-3 col Tottenham, Atletico Madrid ai quarti

-

Champions: 4-1 all'Atalanta, il Bayern Monaco ai quarti

-

'Trump non vuole altri attacchi agli impianti energetici iraniani'

'Trump non vuole altri attacchi agli impianti energetici iraniani'

-

Champions: Howe "Tonali ha un problema all'inguine, in dubbio per domenica"

-

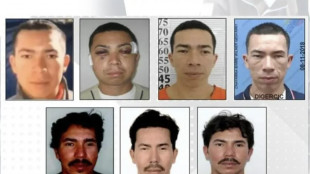

Catturato in Messico 'Lobo Menor', capo della gang ecuadoriana dei Los Lobos

Catturato in Messico 'Lobo Menor', capo della gang ecuadoriana dei Los Lobos

-

Champions: Tonali esce durante Barcellona-Newcastle, Gattuso in ansia

-

Il Costa Rica chiude l'ambasciata a L'Avana ed espelle i diplomatici cubani

Il Costa Rica chiude l'ambasciata a L'Avana ed espelle i diplomatici cubani

-

Cappellari (Intesa), Imprese Vincenti esempio di forza produttiva del Paese

-

Champions: 7-2 al Newcastle, il Barcellona vola ai quarti

Champions: 7-2 al Newcastle, il Barcellona vola ai quarti

-

Pesca: Lollobrigida, credito di imposta al 20% sui carburanti

-

Data zero del Tour 2026 di Amedeo Minghi nel Maceratese a Castelraimondo

Data zero del Tour 2026 di Amedeo Minghi nel Maceratese a Castelraimondo

-

Il Csc omaggia Carlo Di Carlo nel decennale della scomparsa

-

E.League: Italiano 'Roma favorita, noi cerchiamo una nuova impresa all'Olimpico'

E.League: Italiano 'Roma favorita, noi cerchiamo una nuova impresa all'Olimpico'

-

Qatar, incendio nel maggior complesso del gas dopo attacco Iran

-

Atletica: dt La Torre, a Torun voglio un'Italia di carattere

Atletica: dt La Torre, a Torun voglio un'Italia di carattere

-

A mamma non piace, esce postuma la commedia horror-grottesca di Leacche

-

Intesa Sanpaolo premia a Torino dieci pmi eccellenti

Intesa Sanpaolo premia a Torino dieci pmi eccellenti

-

Gb fa retromarcia su IA e diritto d'autore dopo la rivolta dei musicisti

-

Anghileri (Confindustria): 'Bene l'Ue sul 28esimo regime, opportunità concreta'

Anghileri (Confindustria): 'Bene l'Ue sul 28esimo regime, opportunità concreta'

-

La sindaca di Lecce Poli Bortone in visita alla fabbrica della Zecca dello Stato

-

Jovanotti, 'non ho fatto l'università perché mi è scoppiato in mano questo mestiere'

Jovanotti, 'non ho fatto l'università perché mi è scoppiato in mano questo mestiere'

-

Vela: Banti e Tita tornano a gareggiare insieme, "difenderemo l'oro olimpico"

-

Ricostruito in 3D il volto dell'australopiteco Little Foot

Ricostruito in 3D il volto dell'australopiteco Little Foot

-

Caro-carburanti in cdm, si lavora a bonus e stretta anti-speculazione

-

Borsa: Milano chiude debole (-0,33%), giù Enel, Stellantis e Campari

Borsa: Milano chiude debole (-0,33%), giù Enel, Stellantis e Campari

-

Premier: tutti pazzi per Max Dowman, padre e fratello diventano agenti Fifa

-

Caro-carburanti, governo lavora a misure a tempo. Fondi sotto il miliardo

Caro-carburanti, governo lavora a misure a tempo. Fondi sotto il miliardo

-

L'Opera di Roma a Pasqua, cori in concerto nelle chiese della città

-

Salvini 'stasera in cdm taglio accise carburante'

Salvini 'stasera in cdm taglio accise carburante'

-

Codacons, il taglio delle accise deve essere almeno di 20 centesimi

-

Benzina record in Giappone, sfiora i 200 yen. Stop alle patatine

Benzina record in Giappone, sfiora i 200 yen. Stop alle patatine

-

In 4 anni iniziative Cdp per oltre 2,6 miliardi per le Regioni

-

Borsa: Milano chiude in ribasso, -0,33%

Borsa: Milano chiude in ribasso, -0,33%

-

Borsa: Europa in ordine sparso nel finale, Milano -0,2%

Minerva 7B, nuova versione della risposta italiana a ChatGpt

Ha 7 miliardi di parametri, più del doppio di quella precedente

Minerva, la risposta italiana all'Intelligenza Artificiale come ChatGpt, cresce e diventa più sicura: si chiama Minerva7B, dove 7B sta per 7 miliardi di parametri, più del doppio di quella precedente. L'ultima versione dell'Intelligenza Artificiale interamente addestrata da zero in italiano, sotto la guida di Roberto Navigli del Natural Language Processing dell'Università Sapienza di Roma, è stata presentata oggi nella stessa università. Accessibile per tutti all'indirizzo https://minerva-llm.org , Minerva7B è un progetto sviluppato dal gruppo di ricerca Sapienza Nlp all'interno del Future Artificial Intelligence Research, il progetto che realizza la strategia nazionale sull'intelligenza artificiale grazie ai fondi Pnrr, e in collaborazione con Cineca che ha reso disponibile il supercomputer Leonardo. "Oggi presentiamo il primo modello pre-addestrato in lingua italiana stile ChatGpt, quindi un modello linguistico, che si chiama Minerva 7B", ha detto Navigli. "E' un modello che è addestrato anche per rispondere a domande e istruzioni, comandi ed è particolarmente interessante perché abbiamo fatto un lavoro importante sulla sicurezza del modello, la cosiddetta safety, cioè la capacità del modello di evitare e rispondere a domande che potrebbe portare alla generazione di contenuti indesiderati o malevoli". Evoluzione e miglioramento del precedente modello che contava 3 miliardi di parametri, Minerva 7B ha una maggior capacità di memorizzazione e rielaborazione dei testi, sempre basata su fonti aperte di dati che spaziano da Wikipedia e grandi archivi aperti di libri come il progetto Gutemberg. "A differenza di ChatGpt o Gemini, che sono modelli chiusi così come anche Mistral o Llama3 che sono scaricabili, Minerva appartiene a quella ristretta famiglia di modelli aperti, ossia che è possibile analizzare liberamente", ha aggiunto Navigli. .

M.Thompson--AMWN