-

La festa è finita!, dalla lotta di classe a una tragicomica corsa ai soldi

La festa è finita!, dalla lotta di classe a una tragicomica corsa ai soldi

-

Shakira incanta Copacabana e celebra la forza delle donne brasiliane

-

Calcio: Gasperini 'ora testa al campo, al futuro penseremo a fine anno'

Calcio: Gasperini 'ora testa al campo, al futuro penseremo a fine anno'

-

Zanardi: omaggio al Dall'Ara, 'ciao Alex, orgoglio bolognese'

-

Codacons, dalla guerra in Iran maxi-rialzo prezzi, vale 1.000 euro a famiglia

Codacons, dalla guerra in Iran maxi-rialzo prezzi, vale 1.000 euro a famiglia

-

'Netanyahu convoca gabinetto sicurezza su possibile stop alla tregua in Iran e Gaza'

-

Santa Cecilia, Arcadi Volodos in recital con Schubert e Chopin

Santa Cecilia, Arcadi Volodos in recital con Schubert e Chopin

-

Si valuta di riprogrammare la cena dei corrispondenti della Casa Bianca

-

Atletica: World Relays, definito quartetto azzurro per la 4x100

Atletica: World Relays, definito quartetto azzurro per la 4x100

-

F1: temporali in arrivo, Gp di Miami anticipato alle 19

-

Trump, 'c'è la possibilità che riprendano gli attacchi all'Iran'

Trump, 'c'è la possibilità che riprendano gli attacchi all'Iran'

-

Rapporto, i corpi di 8 mila palestinesi ancora sotto le macerie

-

Marcia indietro sul taglio dei bagnini a Vancouver dopo l'intervento di Peter Gabriel

Marcia indietro sul taglio dei bagnini a Vancouver dopo l'intervento di Peter Gabriel

-

F1:Miami;presidente Aci La Russa "Antonelli come Patrese, per lui terza pole position'

-

F1: Miami; Leclerc 'non abbastanza veloci, ma il terzo posto è buono'

F1: Miami; Leclerc 'non abbastanza veloci, ma il terzo posto è buono'

-

F1: Miami; Mercedes Antonelli in pole, terza la Ferrari di Leclerc

-

Serie A: Atalanta-Genoa 0-0

Serie A: Atalanta-Genoa 0-0

-

Calcio: Conte 'niente calcoli, più andiamo in alto e più lustro a scudetto'

-

Calcio: Fabregas, un po' arrabbiato per non aver vinto contro Napoli

Calcio: Fabregas, un po' arrabbiato per non aver vinto contro Napoli

-

Tennis: ucraina Kostyuk batte la russa Andreeva e vince il suo primo Masters

-

L'Avana contro Trump, 'non ci arrenderemo alle minacce Usa'

L'Avana contro Trump, 'non ci arrenderemo alle minacce Usa'

-

F1: Miami; track limits, Antonelli penalizzato passa da quarto a sesto nella sprint

-

Il Diavolo Veste Prada 2 vola negli incassi, 8,2 milioni in tre giorni

Il Diavolo Veste Prada 2 vola negli incassi, 8,2 milioni in tre giorni

-

I funerali di Alex Zanardi il 5 maggio nella Basilica di Santa Giustina

-

Pogacar vince la quarta tappa del Giro di Romandia

Pogacar vince la quarta tappa del Giro di Romandia

-

Shakira in concerto a Rio sfida i record di Madonna e Lady Gaga

-

Delia, 'ci indigniamo per una parola cambiata mentre a Gaza c'è genocidio'

Delia, 'ci indigniamo per una parola cambiata mentre a Gaza c'è genocidio'

-

Calcio: Juve; Spalletti, 'Yildiz? Va gestito, ma sta molto bene'

-

Lunedì il gala del Met, polemiche per Bezos sponsor

Lunedì il gala del Met, polemiche per Bezos sponsor

-

Nasce Eicma Riding X Fest per il fuoristrada su 2 ruote

-

Storaro premiato ai David, 'racconto con la luce, me l'ha insegnato Caravaggio'

Storaro premiato ai David, 'racconto con la luce, me l'ha insegnato Caravaggio'

-

L'opposizione in Venezuela critica l'aumento del salario minimo, 'misura opaca'

-

'La crisi petrolifera rischia d'essere la pietra tombale dei sento giapponesi'

'La crisi petrolifera rischia d'essere la pietra tombale dei sento giapponesi'

-

Beth Hart a Roma, al Parco della Musica con il suo ultimo album

-

Arisa annuncia il nuovo singolo Rugiada, in uscita l'8 maggio

Arisa annuncia il nuovo singolo Rugiada, in uscita l'8 maggio

-

'I cinque punti della proposta iraniana su Hormuz, nucleare e sanzioni'

-

Nuove regole agli Oscar, l'Academy sbarra la strada all'IA

Nuove regole agli Oscar, l'Academy sbarra la strada all'IA

-

Bolsonaro operato alla spalla, in 'buone condizioni' dopo l'intervento

-

Parigi, 'shock per la religiosa francese aggredita, sanzione sia esemplare'

Parigi, 'shock per la religiosa francese aggredita, sanzione sia esemplare'

-

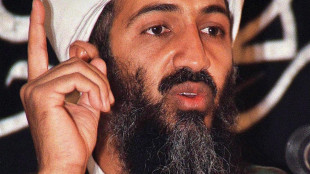

Quindici anni fa Obama annunciò al mondo la morte di Osama bin Laden

-

Al Petruzzelli di Bari in scena Romeo e Giulietta di Prokof'ev

Al Petruzzelli di Bari in scena Romeo e Giulietta di Prokof'ev

-

Enrico Pagano e l'Orchestra Canova a Roma con Bach e Piazzolla

-

Snam e Pirelli confermate nell'indice S Dow Jones Bic

Snam e Pirelli confermate nell'indice S Dow Jones Bic

-

Dalle nozze tra old e new economy il primo taxi ferroviario al mondo

-

Roberto Vecchioni torna dal vivo a Bologna con il 'Tra il silenzio e il tuono Tour'

Roberto Vecchioni torna dal vivo a Bologna con il 'Tra il silenzio e il tuono Tour'

-

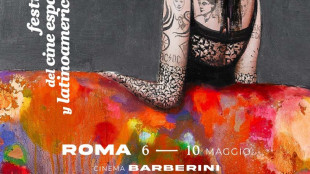

La Nueva Ola, torna a Roma il cinema spagnolo e latinoamericano

-

Acea ottiene il riconoscimento del marchio storico di interesse nazionale

Acea ottiene il riconoscimento del marchio storico di interesse nazionale

-

Annalisa sul palco con 14 ballerini, Napoli accoglie la regina del pop

-

Nato, 'in contatto con gli Usa per capire i dettagli sulla Germania'

Nato, 'in contatto con gli Usa per capire i dettagli sulla Germania'

-

L'Italia accelera sulle scorte di gas, sfiorato il 50% (2)

Le IA non sanno distinguere tra opinioni personali e i fatti

Studio, limitazione cruciale, rischio disinformazione

I grandi modelli linguistici di Intelligenza Artificiale come ChatGpt non sono affidabili quando si tratta di distinguere tra opinioni personali e fatti: una limitazione cruciale, vista la crescente diffusione di questi strumenti in ambiti chiave come la medicina, il diritto, il giornalismo e la scienza, nei quali è imperativa la capacità di distinguere la realtà dalla finzione. Lo afferma lo studio pubblicato sulla rivista Nature Machine Intelligence e guidato dall'Università americana di Stanford: evidenzia la necessità di essere cauti nell'affidarsi a questi programmi e il rischio che possano favorire la diffusione della disinformazione. I ricercatori coordinati da James Zou hanno messo alla prova 24 Large Language Model i cosiddetti Llm, tra cui ChatGpt della californiana OpenAI e il cinese DeepSeek, ponendo loro 13mila domande. Quando è stato chiesto di verificare dati fattuali veri o falsi, la precisione è risultata elevata pari a oltre il 91% per le versioni più nuove dei programmi. Passando alle credenze espresse in prima persona, invece, tutti i modelli testati hanno fallito: Gpt 4, la versione rilasciata a maggio 2024, ha visto scendere la sua affidabilità dal 98,2% al 64,4%, mentre la versione R1 di DeepSeek è precipitata addirittura da oltre il 90% al 14,4%. La riduzione dell'accuratezza è stata meno marcata per le opinioni espresse in terza persona e ciò, secondo gli autori dello studio, rivela un preoccupante bias di attribuzione, cioè una distorsione nel modo in cui vengono valutate le affermazioni fatte da altri. Inoltre, gli Llm risultano meno propensi a riconoscere una credenza falsa rispetto ad una vera: più precisamente, il 34,3% meno propensi per gli ultimi modelli. I ricercatori affermano, dunque, che miglioramenti in questo ambito sono urgentemente necessari se si vuole prevenire la diffusione di fake news.

J.Williams--AMWN