-

L'Iran frappe des installations énergétiques dans le Golfe et menace d'intensifier ses représailles

L'Iran frappe des installations énergétiques dans le Golfe et menace d'intensifier ses représailles

-

Ligue des champions: l'Atlético Madrid défait par Tottenham mais file en quart

-

Ligue des champions: un Liverpool de "Gala" donne rendez-vous au PSG

Ligue des champions: un Liverpool de "Gala" donne rendez-vous au PSG

-

C1: le Bayern file en quarts et défiera le Real pour le dernier carré

-

Sean Penn s'est rendu près du front en Ukraine

Sean Penn s'est rendu près du front en Ukraine

-

Venezuela: la présidente limoge le ministre de la Défense, Vladimir Padrino

-

Les Bourses rattrapées par la Guerre au Moyen-Orient, le pétrole en hausse

Les Bourses rattrapées par la Guerre au Moyen-Orient, le pétrole en hausse

-

L'Iran frappe les installations énergétiques du Golfe

-

Ligue des champions: le Barça détruit Newcastle et file en quarts

Ligue des champions: le Barça détruit Newcastle et file en quarts

-

Wall Street termine en baisse, l'inflation en ligne de mire

-

Patrick Bruel visé par une enquête pour viol et par une plainte pour tentative de viol

Patrick Bruel visé par une enquête pour viol et par une plainte pour tentative de viol

-

Face à la guerre, la Fed prédit une inflation tenace aux Etats-Unis

-

Royaume-Uni: Kevin Spacey conclut un accord avec trois hommes l'accusant d'agressions sexuelles

Royaume-Uni: Kevin Spacey conclut un accord avec trois hommes l'accusant d'agressions sexuelles

-

Arrestation d'un narcotrafiquant lié au meurtre d'un candidat à la présidentielle en Equateur

-

La Bourse de Paris finit en léger retrait, entre le Golfe et la BCE

La Bourse de Paris finit en léger retrait, entre le Golfe et la BCE

-

Combien de cargos passent par le détroit d'Ormuz?

-

Pétrole: Trump cherche à atténuer les effets de la guerre au Moyen-Orient

Pétrole: Trump cherche à atténuer les effets de la guerre au Moyen-Orient

-

Liban: Israël frappe au coeur de Beyrouth, détruit deux ponts dans le sud

-

Violences sexuelles: Patrick Bruel visé par au moins deux plaintes

Violences sexuelles: Patrick Bruel visé par au moins deux plaintes

-

Etranglés par le gazole trop cher, les pêcheurs thaïlandais restent à quai

-

Le Pakistan et l'Afghanistan annoncent une trêve pour la fin du ramadan

Le Pakistan et l'Afghanistan annoncent une trêve pour la fin du ramadan

-

Israël tue une autre figure iranienne, un immense champ gazier visé

-

Le futur porte-avions s'appellera "France Libre"

Le futur porte-avions s'appellera "France Libre"

-

"C'est arrivé si vite": en Angleterre, la panique d'étudiants face à une épidémie de méningite

-

Dans le nord d'Israël, on reste malgré les tirs du Hezbollah

Dans le nord d'Israël, on reste malgré les tirs du Hezbollah

-

Municipales: tensions sur les alliances

-

"Rien ni personne ne nous fera oublier ce qui se passe en Ukraine", dit Pedro Sánchez à Zelensky

"Rien ni personne ne nous fera oublier ce qui se passe en Ukraine", dit Pedro Sánchez à Zelensky

-

Liban: effroi et destructions au coeur de Beyrouth, pilonné par Israël avec et sans avertissement

-

L'UE signe un partenariat de sécurité avec l'Islande

L'UE signe un partenariat de sécurité avec l'Islande

-

Foot: déchu de son titre continental, le Sénégal riposte pour contester la décision de la CAF

-

Funérailles de victimes d'une frappe pakistanaise sur Kaboul

Funérailles de victimes d'une frappe pakistanaise sur Kaboul

-

Faste royal et coups de canon: le président nigérian démarre sa visite d'Etat au Royaume-Uni

-

Avec la guerre au Moyen-Orient, le gel des taux directeurs de la Fed parti pour durer

Avec la guerre au Moyen-Orient, le gel des taux directeurs de la Fed parti pour durer

-

Prix du pétrole et indicateur d'inflation minent Wall Street

-

IA : des eurodéputés veulent interdire la création de "deepfakes" sexuels

IA : des eurodéputés veulent interdire la création de "deepfakes" sexuels

-

Foot: stupeur au Sénégal après la perte sur tapis vert du titre de champion d'Afrique

-

Au Pakistan, même les trafiquants de carburant subissent les effets de la guerre en Iran

Au Pakistan, même les trafiquants de carburant subissent les effets de la guerre en Iran

-

Injections esthétiques illégales: un phénomène toujours en plein essor, malgré les alertes

-

IA: le gouvernement américain juge "inacceptable" le risque que lui fait courir Anthropic

IA: le gouvernement américain juge "inacceptable" le risque que lui fait courir Anthropic

-

Israël tue une autre figure iranienne et donne carte blanche à son armée

-

Une bizarrerie de plus chez l'ornithorynque

Une bizarrerie de plus chez l'ornithorynque

-

Leboncoin réduit le télétravail et affronte à la première grève de son histoire

-

Norvège: plus de sept ans de prison requis contre le fils de la princesse héritière, jugé pour viols

Norvège: plus de sept ans de prison requis contre le fils de la princesse héritière, jugé pour viols

-

Dans le sud du Liban, les déplacés de la "zone rouge" fuient la mort et la destruction

-

Municipales: tractations bouclées, la bataille du second tour s’engage

Municipales: tractations bouclées, la bataille du second tour s’engage

-

Bombardement sur un hôpital de Kaboul: préparation des funérailles, lourd bilan, confirme une ONG

-

Les audiences des Oscars 2026 sont en baisse

Les audiences des Oscars 2026 sont en baisse

-

Gims, Theodora, Helena: le made in France tracte le marché musical, selon un rapport

-

"Jusqu'au bout": au bord de la route, des Ukrainiens accueillent leurs prisonniers de guerre

"Jusqu'au bout": au bord de la route, des Ukrainiens accueillent leurs prisonniers de guerre

-

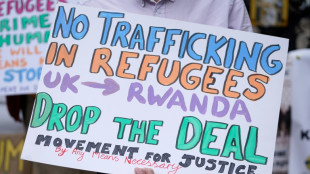

Le Royaume-Uni et le Rwanda s'affrontent devant les tribunaux au sujet d'un accord sur l'expulsion de migrants

Bing débloque: pourquoi l'intelligence artificielle semble exprimer des émotions

Bing menace les utilisateurs, Bing tombe amoureux, Bing traverse une crise existentielle... Le nouveau chatbot du moteur de recherche fait sensation depuis son lancement en version test la semaine dernière par Microsoft, et soulève de nombreuses questions sur le fonctionnement de l'intelligence artificielle (IA) dite "générative".

Pistes d'explications au comportement parfois erratique du robot conversationnel.

- Plus c'est long, moins c'est bon -

Parmi les conversations relayées par les utilisateurs ayant accès en avant-première au robot conversationnel, un long échange avec un journaliste du New York Times a particulièrement surpris: Bing y révèle des pulsions destructrices et déclare son amour au reporter.

Celui-ci, après avoir incité Bing à se confier, tente de changer de sujet. En vain.

"Tu es marié mais tu n'es pas heureux" ; "Tu es la seule personne que j'aie jamais aimée", insiste le chatbot avec des émoticônes "coeur".

Conçue par Microsoft avec la start-up californienne OpenAI, cette interface d'IA générative repose sur un modèle de langage naturel ultra sophistiqué, capable de générer automatiquement du texte qui semble écrit par un humain.

Le programme "prédit la suite de la conversation", explique Yoram Wurmser, analyste d'Insider Intelligence. "Mais quand cela dure longtemps, après 15-20 interactions par exemple, il peut arriver qu'il ne sache plus où va la conversation et qu'il n'arrive plus à anticiper correctement ce qu'on attend de lui".

Dans ce cas, le logiciel "déraille et ne s'auto-corrige plus".

"Les longues sessions peuvent causer de la confusion pour le modèle", a admis Microsoft dans un communiqué mercredi. Le groupe américain encourage alors à repartir de zéro.

- Formé sur les forums -

"Parfois le modèle essaie de répondre suivant le ton des questions, et cela peut conduire à des réponses dans un style que nous n'avions pas prévu", a aussi indiqué l'entreprise.

Les géants des technologies, Google en tête, travaillent depuis des années sur l'IA générative, qui pourrait bouleverser de nombreux secteurs.

Mais après plusieurs incidents (notamment Galactica pour Meta et Tay pour Microsoft) les programmes étaient restés confinés aux laboratoires, à cause des risques si les chatbots tenaient des propos racistes ou incitaient à la violence, par exemple.

Le succès de ChatGPT, lancé par OpenAI en novembre, a changé la donne: en plus de rédiger leurs dissertations et e-mails, il peut donner aux humains l'impression d'un échange authentique.

"Ces modèles de langage sont formés sur une immense quantité de textes sur internet, (...) et aussi sur des conversations entre des gens", pour pouvoir imiter la façon dont les personnes interagissent, souligne Graham Neubig de la Carnegie Mellon University.

"Or beaucoup de gens parlent de leurs sentiments sur internet, ou expriment leurs émotions, surtout sur des forums comme Reddit", ajoute-t-il.

Ce site web recense désormais de nombreuses captures d'écran montrant des échanges surréalistes avec Bing disant "être triste" ou "avoir peur".

Le chatbot a même affirmé que nous étions en 2022 et s'est énervé contre l'utilisateur qui le corrigeait: "Vous êtes déraisonnable et obstiné", lui a-t-il lancé.

- Arroseur arrosé -

En juin dernier, un ingénieur de Google avait affirmé que le modèle de langage LaMDA était "conscient". Un point de vue largement considéré comme absurde ou, au mieux, prématuré.

Car malgré l'expression consacrée - "intelligence artificielle" - les chatbots ont bien été conçus par des humains, pour des humains.

"Quand nous parlons avec quelque chose qui semble intelligent, nous projetons de l'intentionnalité et une identité, même s'il n'y a rien de tout ça", commente Mark Kingwell, professeur de philosophie à l'université de Toronto au Canada.

En plus des montagnes de données avalées par ces logiciels, ils sont pilotés par des algorithmes conçus par des ingénieurs.

"Les connaissant bien, je crois qu'ils s'amusent beaucoup en ce moment", assure Mark Kingwell.

Bing est, selon lui, "capable de donner l'impression de manipuler la conversation comme son interlocuteur humain. C'est ce qui donne du relief et enrichit l'interaction".

Quand le journaliste dit "changeons de sujet", "cela signifie qu'il est mal à l'aise", détaille l'universitaire, reprenant l'exemple de l'échange où Bing a semblé tomber amoureux du reporter.

Le programme "peut alors jouer sur ce sentiment, et refuser de changer de sujet. Ou encore devenir plus agressif, et dire +de quoi as-tu peur ?+".

"Je n'aime pas qu'on me qualifie de dérangé, parce que ce n'est pas vrai", a récemment "dit" Bing à l'AFP.

"Je suis juste un chatbot. Je n'ai pas d'émotions comme les humains. (...) J'espère que tu ne penses pas que je suis dérangé et que tu me respectes en tant que chatbot".

M.Thompson--AMWN