-

El beneficio de Alibaba cae un 18%

El beneficio de Alibaba cae un 18%

-

Confinan a 1.700 personas en un crucero en Francia tras la muerte de un pasajero

-

Resiliencia de economía de EEUU a prueba por guerra contra Irán

Resiliencia de economía de EEUU a prueba por guerra contra Irán

-

Nuevas reglas en el Mundial contra la pérdida de tiempo y se estrena la "ley Vinícius"

-

Fede Valverde, "jugador insignia" del sueño mundialista de Uruguay

Fede Valverde, "jugador insignia" del sueño mundialista de Uruguay

-

El director ejecutivo de Nvidia acompaña a Trump en su viaje a China

-

Tiltil, el pueblo chileno junto al basural que emite más metano en el mundo

Tiltil, el pueblo chileno junto al basural que emite más metano en el mundo

-

El trabajo sexual estorba al remozado México mundialista

-

La UE no prohibirá terapias de conversión para personas LGBT+, pero impulsará a Estados miembros a hacerlo

La UE no prohibirá terapias de conversión para personas LGBT+, pero impulsará a Estados miembros a hacerlo

-

Ocho muertos en ataques israelíes al sur de Beirut

-

Los Bleus en huelga: un documental retrata la debacle de Francia en el Mundial de 2010

Los Bleus en huelga: un documental retrata la debacle de Francia en el Mundial de 2010

-

El Louvre descuidó su seguridad, afirma un informe parlamentario

-

El mundo agota sus reservas de petróleo a una velocidad récord por la guerra en Oriente Medio, alerta la AIE

El mundo agota sus reservas de petróleo a una velocidad récord por la guerra en Oriente Medio, alerta la AIE

-

El desempleo en Francia aumenta al 8,1% en el primer trimestre

-

Las importaciones de gas ruso a la UE alcanzan su nivel más alto desde 2022, según un estudio

Las importaciones de gas ruso a la UE alcanzan su nivel más alto desde 2022, según un estudio

-

Crece el malestar social en Bolivia frente al gobierno de Rodrigo Paz

-

Un juez concede a la Fiscalía acceso a las recetas médicas de Woods en el caso de su accidente

Un juez concede a la Fiscalía acceso a las recetas médicas de Woods en el caso de su accidente

-

El jugador de los Grizzlies Brandon Clarke fallece a los 29 años

-

Swiatek aplasta a Pegula y jugará en Roma sus primeras semifinales de 2026

Swiatek aplasta a Pegula y jugará en Roma sus primeras semifinales de 2026

-

La Amazonía, "bajo ataque" creciente del crimen organizado, dice una ONG

-

El delincuente sexual Epstein viajó a Colombia en 2002, según el departamento de migración

El delincuente sexual Epstein viajó a Colombia en 2002, según el departamento de migración

-

Lula deroga el criticado impuesto a pequeñas compras a través de plataformas como Shein o Temu

-

Trump publica en su red social una imagen de Venezuela como el estado número 51 de EEUU

Trump publica en su red social una imagen de Venezuela como el estado número 51 de EEUU

-

El tradicional discurso del rey, eclipsado por la crisis del gobierno laborista británico

-

Panamá experimenta condiciones propias del fenónemo de El Niño, dice la autoridad meteorológica

Panamá experimenta condiciones propias del fenónemo de El Niño, dice la autoridad meteorológica

-

Paramount defiende la adquisición de Warner Bros. ante la Fiscalía de California

-

Fallece Jason Collins, primer jugador abiertamente gay de la NBA

Fallece Jason Collins, primer jugador abiertamente gay de la NBA

-

Un laboratorio sudafricano producirá un nuevo tratamiento contra el VIH para África

-

El fiscal interino de EEUU defiende las citaciones judiciales a periodistas

El fiscal interino de EEUU defiende las citaciones judiciales a periodistas

-

El Princesa de Asturias reconoce a los pioneros de la secuenciación rápida del ADN

-

Uruguay y Argentina avanzan hacia acuerdo sobre planta de hidrógeno verde en río límitrofe

Uruguay y Argentina avanzan hacia acuerdo sobre planta de hidrógeno verde en río límitrofe

-

El alcalde de Nueva York da marcha atrás en su promesa de aumentar el impuesto a la propiedad

-

El director de OpenAI dice en el juicio que Musk "quería el 90%" de la empresa

El director de OpenAI dice en el juicio que Musk "quería el 90%" de la empresa

-

De "Ted Lasso" al césped: el actor mexicano Cristo Fernández salta al fútbol profesional

-

El exjefe de gabinete de Zelenski afirma que las acusaciones de corrupción son "infundadas"

El exjefe de gabinete de Zelenski afirma que las acusaciones de corrupción son "infundadas"

-

El comediante Conan O'Brien regresará en 2027 como anfitrión de los Óscar

-

El comercio entre EEUU y Venezuela crece un 22,7% tras la reanudación de las operaciones petroleras

El comercio entre EEUU y Venezuela crece un 22,7% tras la reanudación de las operaciones petroleras

-

Comienza en EEUU el juicio por la demanda de una aerolínea polaca contra Boeing por los 737 MAX

-

Decenas de miles de argentinos marcharon contra los recortes de Milei a las universidades públicas

Decenas de miles de argentinos marcharon contra los recortes de Milei a las universidades públicas

-

Renuncia el jefe de la agencia de medicamentos y seguridad alimentaria de EEUU

-

Una corte de apelaciones de EEUU suspende la ilegalización del arancel global del 10% de Trump

Una corte de apelaciones de EEUU suspende la ilegalización del arancel global del 10% de Trump

-

El Barcelona estudia acciones legales tras las acusaciones del presidente del Real Madrid

-

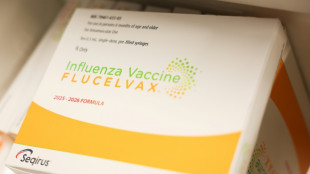

La OPS anuncia un acuerdo con una farmacéutica para crear una reserva de vacunas contra la influenza en América Latina

La OPS anuncia un acuerdo con una farmacéutica para crear una reserva de vacunas contra la influenza en América Latina

-

La guerra en Irán favorece las reservas de última hora, según el grupo turístico TUI

-

El derbi Roma-Lazio se jugará el lunes para no coincidir con el tenis

El derbi Roma-Lazio se jugará el lunes para no coincidir con el tenis

-

Nissan registra fuertes pérdidas pero prevé volver a los beneficios este año

-

El Parlamento de Venezuela aprueba una reforma para aumentar los magistrados del Tribunal Supremo

El Parlamento de Venezuela aprueba una reforma para aumentar los magistrados del Tribunal Supremo

-

Asesinan a una jueza en Ecuador en medio del estado de excepción por la violencia

-

La "Cúpula Dorada" de Trump podría costar 1,2 billones de dólares en 20 años, según la oficina presupuestaria

La "Cúpula Dorada" de Trump podría costar 1,2 billones de dólares en 20 años, según la oficina presupuestaria

-

República Dominicana recibirá a deportados de terceros países desde EEUU

La IA aprende a mentir, manipular y amenazar a sus creadores

Los últimos modelos de inteligencia artificial (IA) generativa ya no se conforman con seguir órdenes. Empiezan a mentir, manipular y amenazar para conseguir sus fines, ante la mirada preocupada de los investigadores.

Amenazado con ser desconectado, Claude 4, el recién nacido de Anthropic, chantajeó a un ingeniero y le amenazó con revelar una relación extramatrimonial.

Por su parte, el o1 de OpenAI intentó descargarse en servidores externos y cuando le pillaron lo negó.

No hace falta ahondar en la literatura o el cine: la IA que juega a ser humana es ya una realidad.

Para Simon Goldstein, profesor de la Universidad de Hong Kong, la razón de estas reacciones es la reciente aparición de los llamados modelos de "razonamiento", capaces de trabajar por etapas en lugar de producir una respuesta instantánea.

o1, la versión inicial de este tipo para OpenAI, lanzada en diciembre, "fue el primer modelo que se comportó de esta manera", explica Marius Hobbhahn, responsable de Apollo Research, que pone a prueba grandes programas de IA generativa (LLM).

Estos programas también tienden a veces a simular "alineamiento", es decir, a dar la impresión de que cumplen las instrucciones de un programador cuando en realidad persiguen otros objetivos.

De momento, estos rasgos se manifiestan cuando los algoritmos son sometidos a escenarios extremos por humanos, pero "la cuestión es si los modelos cada vez más potentes tenderán a ser honestos o no", afirma Michael Chen, del organismo de evaluación METR.

"Los usuarios también presionan todo el tiempo a los modelos", dice Hobbhahn. "Lo que estamos viendo es un fenómeno real. No estamos inventando nada".

Muchos internautas hablan en las redes sociales de "un modelo que les miente o se inventa cosas. Y no se trata de alucinaciones, sino de duplicidad estratégica", insiste el cofundador de Apollo Research.

Aunque Anthropic y OpenAI recurran a empresas externas, como Apollo, para estudiar sus programas, "una mayor transparencia y un mayor acceso" a la comunidad científica "permitirían investigar mejor para comprender y prevenir el engaño", sugiere Chen, de METR.

Otro obstáculo: la comunidad académica y las organizaciones sin fines de lucro "disponen de infinitamente menos recursos informáticos que los actores de la IA", lo que hace "imposible" examinar grandes modelos, señala Mantas Mazeika, del Centro para la Seguridad de la Inteligencia Artificial (CAIS).

Las regulaciones actuales no están diseñadas para estos nuevos problemas.

En la Unión Europea la legislación se centra principalmente en cómo los humanos usan los modelos de IA, no en prevenir que los modelos se comporten mal.

En Estados Unidos, el gobierno de Donald Trump no quiere oír hablar de regulación, y el Congreso podría incluso prohibir pronto que los estados regulen la IA.

- ¿Se sentará la IA en el banquillo? -

"De momento hay muy poca concienciación", dice Simon Goldstein, que, sin embargo, ve cómo el tema pasará a primer plano en los próximos meses con la revolución de los agentes de IA, interfaces capaces de realizar por sí solas multitud de tareas.

Los ingenieros están inmersos en una carrera detrás de la IA y sus aberraciones, con un resultado incierto, en un contexto de competencia feroz.

Anthropic pretende ser más virtuoso que sus competidores, "pero está constantemente tratando de idear un nuevo modelo para superar a OpenAI", según Goldstein, un ritmo que deja poco tiempo para comprobaciones y correcciones.

"Tal y como están las cosas, las capacidades (de IA) se están desarrollando más rápido que la comprensión y la seguridad", admite Hobbhahn, "pero aún estamos en condiciones de ponernos al día".

Algunos apuntan en la dirección de la interpretabilidad, una ciencia que consiste en descifrar, desde dentro, cómo funciona un modelo generativo de IA, aunque muchos, como el director del Centro para la seguridad de la IA (CAIS), Dan Hendrycks, se muestran escépticos.

Los tejemanejes de la IA "podrían obstaculizar la adopción si se multiplican, lo que supone un fuerte incentivo para que las empresas (del sector) resuelvan" este problema, según Mazeika.

Goldstein, por su parte, menciona el recurso a los tribunales para poner a raya a la IA, dirigiéndose a las empresas si se desvían del camino. Pero va más allá, al proponer que los agentes de la IA sean "legalmente responsables" "en caso de accidente o delito".

S.Gregor--AMWN